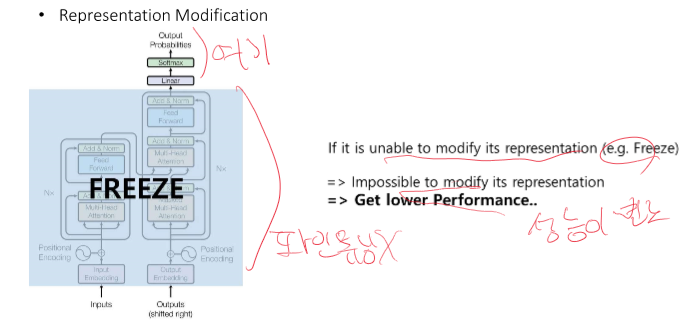

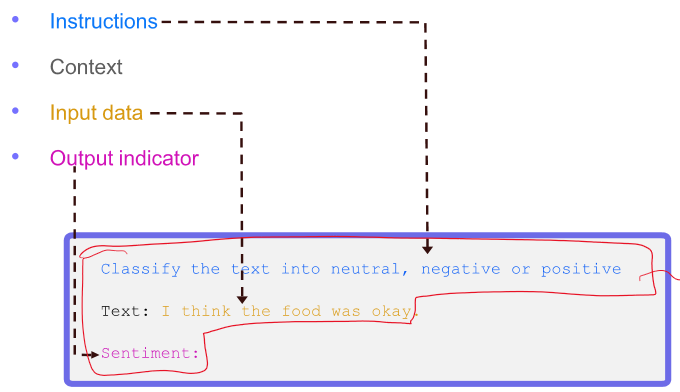

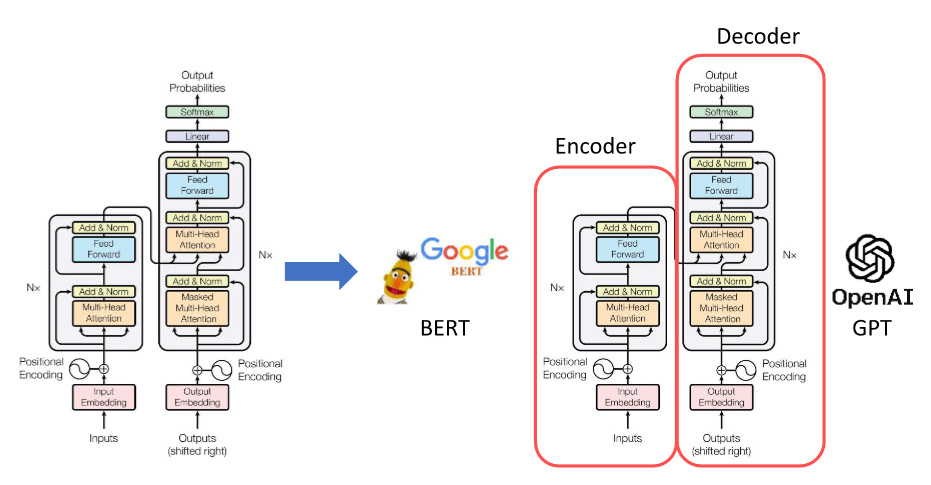

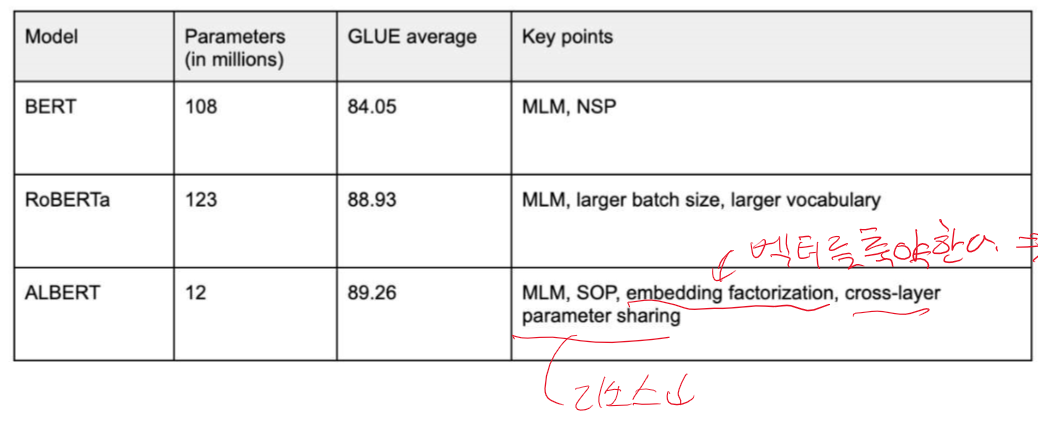

LLM의 파라미터를 효율적으로, 효과적으로 튜닝하는 방법이다.언어 모델은 Semi supervised learning (NSP, Masking)을 통해 Pre-trained하고, Supervised learning을 통해 fine tuning을 진행한다. 이전에는 각 task마다 fine tuning을 진행하여 여러개의 모델을 만들었으나 요즘엔 모델 하나하나의 크기가 거대해져서 fine tuning을 그렇게 진행할 수 없고, task 종류도 너무 많이 늘었다. 전체 파라미터를 수정하기 어려우니 일부분만 학습하기로 하였다. Adapters - 필요한 부분만 (전체 파라미터의 3% 정도) 바꾸어 전체를 파인 튜닝 한 모델과 큰 차이가 나지 않은 정확도를 보였다. fine-tuning은 특정 task의 los..