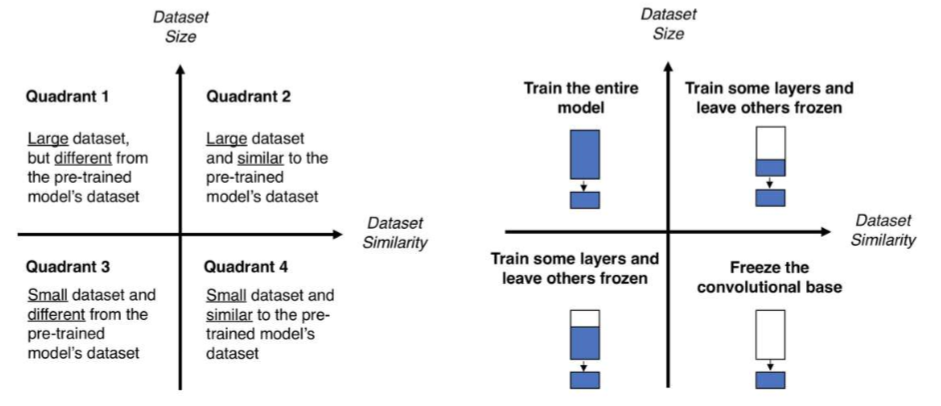

머신러닝의 종류에는 지도, 비지도 강화학습이 있다. 지도학습은 학습셋에 데이터와 라벨이 묶여있다.비지도 학습은 라벨이 존재하지 않고, 데이터의 패턴끼리 묶는다. 그러나 높은 성과를 기대하기 어렵다. pre-training = 라벨되거나, 라벨되지 않은 대량의 데이터를 가지고 모델을 학습시킨다.fine-tuning = 지식을 추가하기 위해 라벨된 데이터를 모델에 학습시킨다.데이터 양, 유사도에 따라 fine-tuning할 때 weight의 변화를 조절한다. Self supervised lenring은 unsupervised learning으로 pre training 진행할 때 라벨이 없는 데이터를 가지고 학습하는 것을 뜻한다. Pretext task를 진행한다. RoBERTa기존의 Static Maskin..