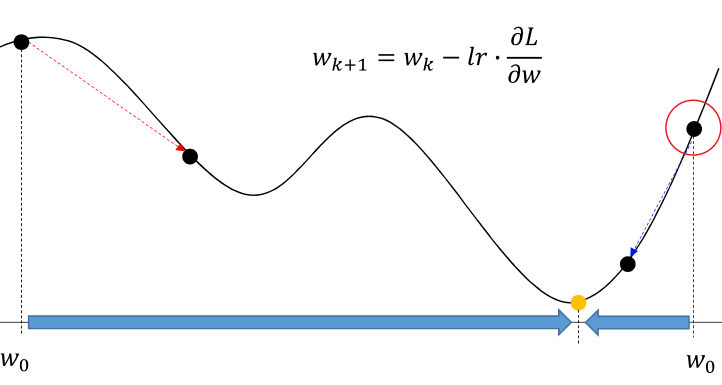

Initialization 빠르게, 그리고 global minimun을 찾기 위해 Initialization은 중요하다. 위 사진만 봐도 금방 끝날 학습은 바로 보인다. 이전에도 나온 적 있는 그림이다. backpropagation을 하면서 gradient가 소실되는 것이다. vanishing gradient의 원인인 sigmoid와 tanh의 미분 브래프 이다. sigmoid는 미분하면 최대가 0.3이고, tanh는 1이고, 둘 다 양끝은 0이기 때문에 반복하다 보면 기울기 소실이 발생하는 것이다. 그리하여 나온 것이 ReLU이다. 그래도 여기서도 0이하의 값들이 소실되는 문제가 발생한다.(dying ReLU) 기울기 폭주는 너무 큰 기울기 값이 들어갔을 때 발생한다. 이것은 학습이 불안정해 지도록 만..