Auto encoder

오른쪽은 처음보네요

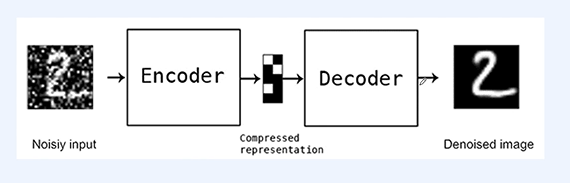

중요한 정보들만 남기고 나머지 정보는 손실 됩니다.

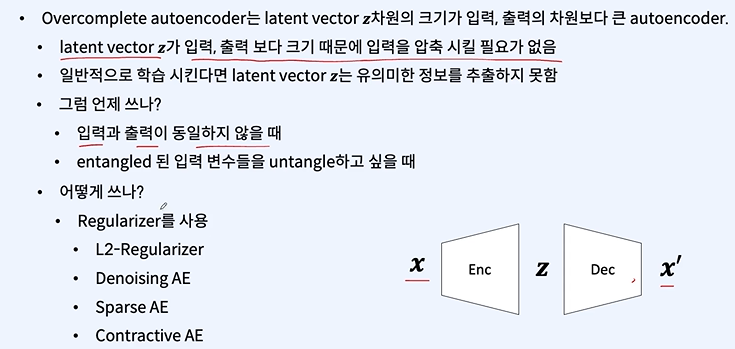

z가 그대로 x를 카피할 수 있다. 그러므로 특별한 방식이 필요하다.

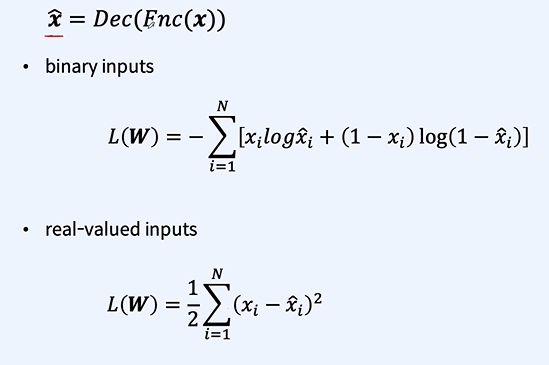

i는 데이터의 개수가 아닌 차원이다. 즉 N은 차원의 수 이다.

노이즈를 주고 원래 데이터로 돌아가도록 학습!

2023.12.14 - [인공지능/공부] - 생성형 인공지능 Autoencoder - 개념

생성형 인공지능 Autoencoder - 개념

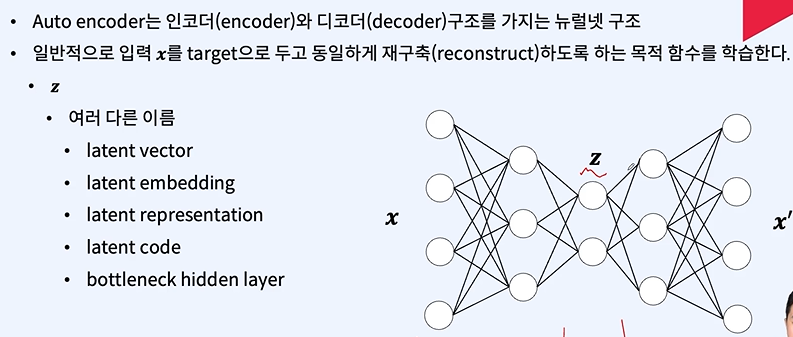

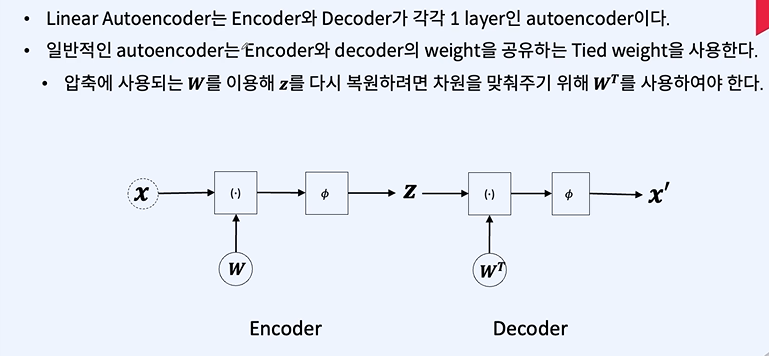

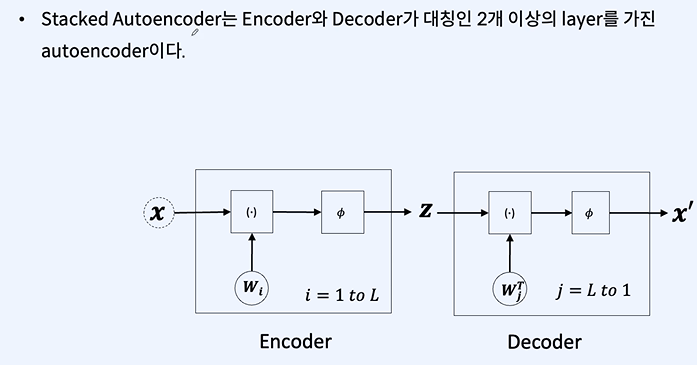

여태까지 FCN, CNN, CAM 모두 supervised learning였다. 즉 지도학습으로 input(data)와 정답(label)이 주어지는 학습이었다. 그러나 오늘 다룰 Autoencoder는 label이 없는 즉 정답이 input인 unsupervised learning이다. 나

yoonschallenge.tistory.com

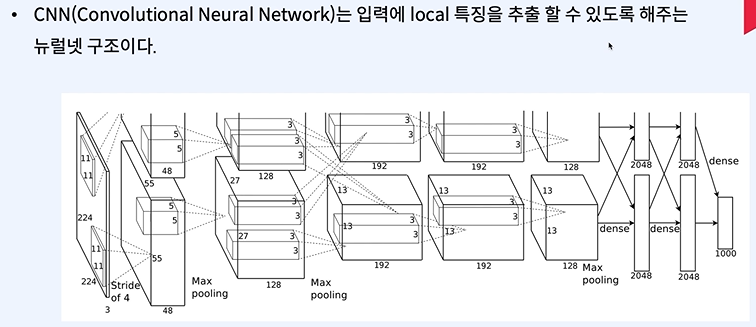

CNN

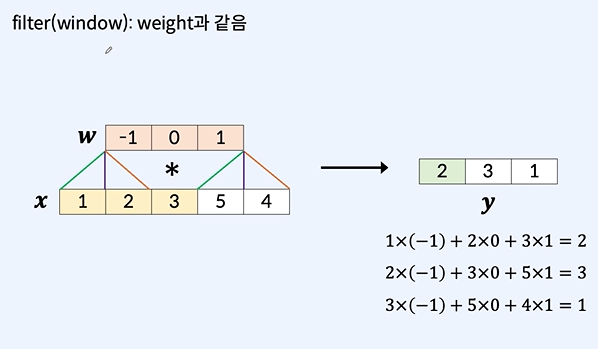

겅중겅중 건너뛰는것

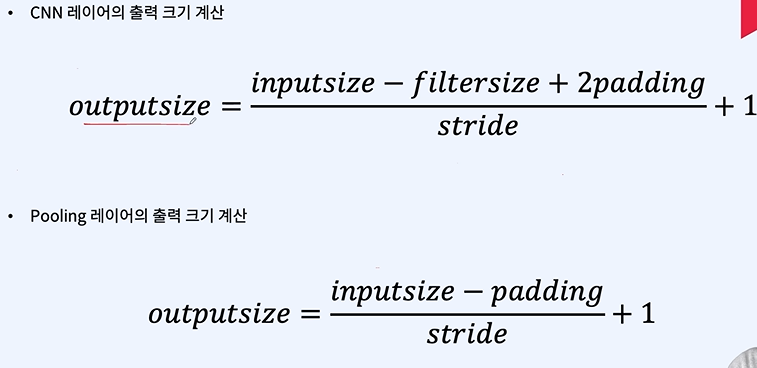

stride가 커질수록 결과가 작아진다.

padding을 둔다!

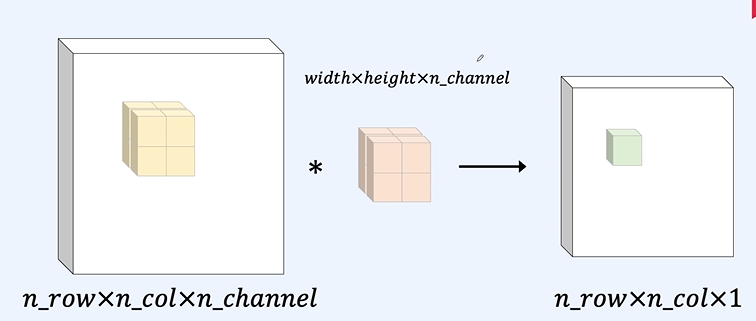

채널의 차원이 추가되었다.

필터를 여러개 사용하면 결과도 채널을 늘릴 수 있다.

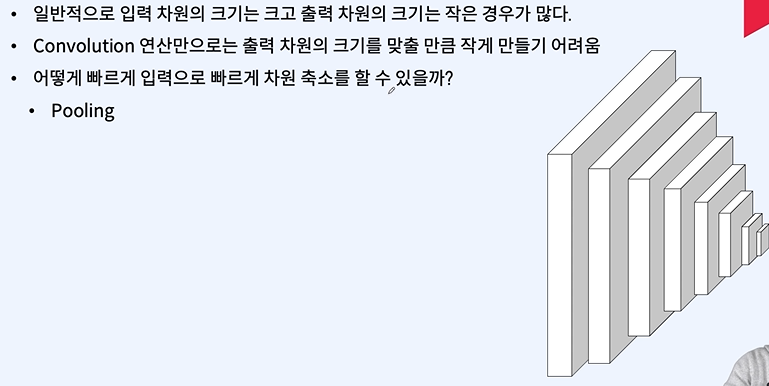

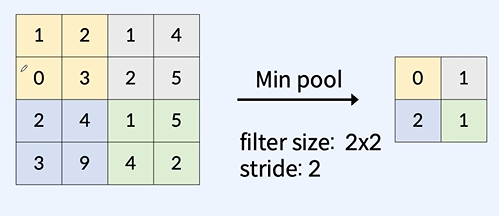

보통 stride 2, 필터 사이즈 2를 사용한다.

이거 사용하는 것은 못봤네요

이건 CAM에서 사용했네요

2023.12.14 - [인공지능/공부] - CAM 실습 - MNIST, TensorFlow

CAM 실습 - MNIST, TensorFlow

import numpy as np import matplotlib.pyplot as plt import tensorflow as tf from tensorflow.keras.datasets import mnist from tensorflow.keras.models import Model from tensorflow.keras.layers import Input, Conv2D, BatchNormalization, Activation, GlobalAverag

yoonschallenge.tistory.com

actvation function은 항상 있다고 생각하시면 됩니다.

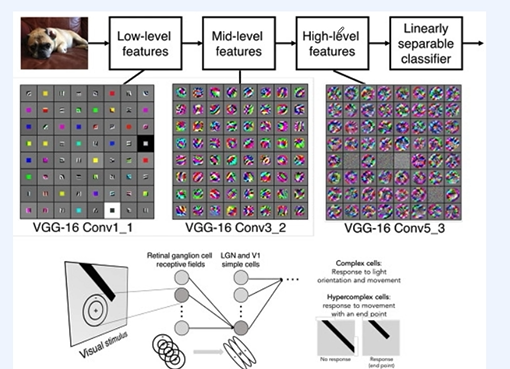

이건 굉장히 추상화 된것이므로 적당히 보고 넘기자

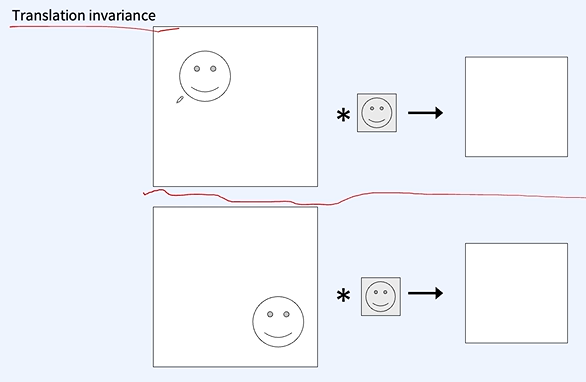

어느 위치에서든 찾을 수 있다는 장점! Shared Parameters

'인공지능 > 자연어 처리' 카테고리의 다른 글

| 자연어 처리 - Transformer (1) | 2024.01.21 |

|---|---|

| 자연어 처리 - RNN, LSTM (0) | 2024.01.17 |

| 자연어 처리 - Loss function (0) | 2024.01.17 |

| 자연어 처리 - 모델 학습 (0) | 2024.01.17 |

| 자연어 처리 - 과적합 방지 (0) | 2024.01.17 |