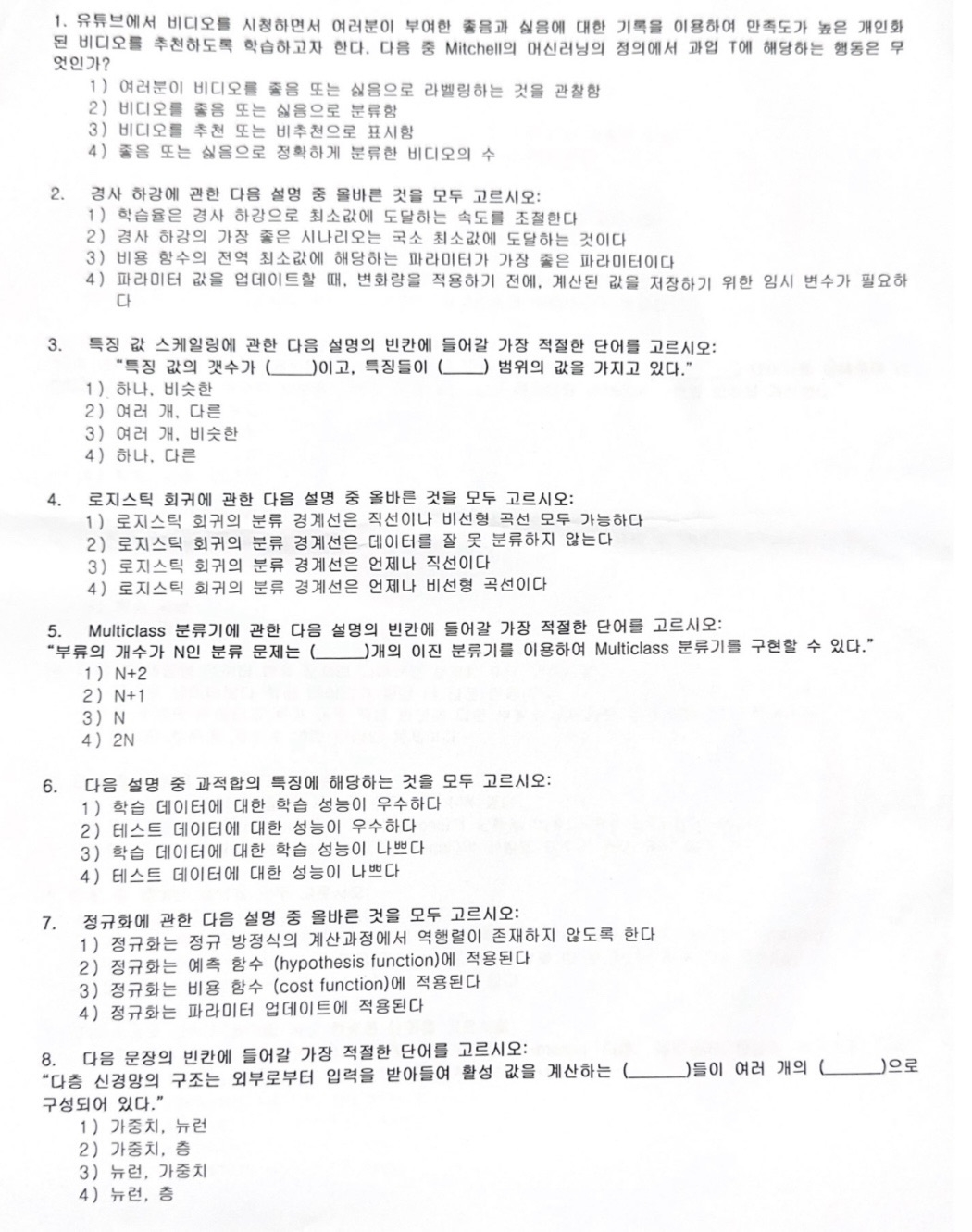

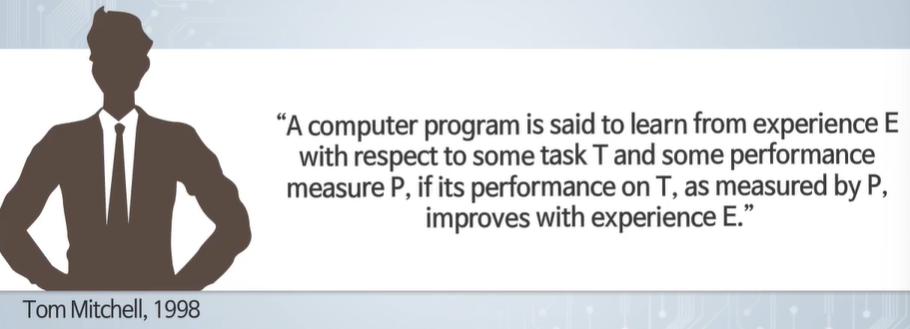

1번

일 T와 성능지표 P로부터 경험 E를 통해 학습한다. 경험으로부터 학습한다!

3번 아닌가...?

2.

1맞고

2전역최소

3번 겁나 애매하네 test할 때는 가장 좋은게 아닐 수 있는데 그럼 아니라고 가자

4맞다 하나하나 바꿔버리면 오류 발생 가능 한번에 바꿔야 된다.

3

여러개고 다른 것을 비슷한 것으로 바꿔주는 건데 문제 진짜 싫어.... 애매해....

4

1.가능

2.그럼 왜 분류한다 그르냐 분류 잘하지. 아니네 잘 못 분류하지 않는다..ㅋㅋㅋㅋㅋ.ㅠ

3. 비선형 가능

4. 선형 가능

5

1vs all도 n개만 있으면 됩니다.

6

1 맞습니다

2 테스트는 나쁩니다

3 학습에 좋습니다

4 맞습니다

7

1. ? ??? 진짜 뭐지 역행렬이 만들어 진다네요

2. 아뇨

3. 이게 맞아요

4. cost function에 들어가니 파라미터 업데이트에 들어가죠

정규화(Regularization)는 선형 회귀에서 과적합(overfitting)을 방지하기 위해 모델의 복잡성을 제어하는 기법입니다. 정규화에는 주로 L2 정규화(Ridge 회귀)와 L1 정규화(Lasso 회귀)가 사용됩니다. 여기서 중요한 개념은 정규화가 역행렬의 존재 여부와 어떤 관계가 있는지입니다.

L2 정규화 (Ridge 회귀)

L2 정규화는 비용 함수에 가중치의 제곱합을 추가하여 모델의 복잡성을 제어합니다. 정규화 항을 추가한 비용 함수는 다음과 같이 정의됩니다:

[ J(\theta) = \frac{1}{2m} \sum_{i=1}^{m} (h_\theta(x^{(i)}) - y^{(i)})^2 + \frac{\lambda}{2m} \sum_{j=1}^{n} \theta_j^2 ]

여기서 (\lambda)는 정규화 파라미터입니다. 정규화된 선형 회귀의 매개변수 (\theta)를 찾기 위해서는 다음과 같은 정상 방정식을 사용합니다:

[ \theta = (X^TX + \lambda I)^{-1}X^Ty ]

여기서 (I)는 단위 행렬입니다.

역행렬의 존재 여부

정규화 항 (\lambda I)를 추가하면, (X^TX + \lambda I)는 항상 역행렬이 존재하게 됩니다. 이유는 다음과 같습니다:

- (X^TX)는 대칭 행렬이고, 보통은 양의 정부호 행렬입니다.

- (\lambda I)는 항상 양의 정부호 행렬입니다 (모든 (\lambda > 0)).

양의 정부호 행렬 두 개의 합은 여전히 양의 정부호 행렬이므로, (X^TX + \lambda I)는 항상 역행렬이 존재합니다.

결론

시험 선지에서 "정규화를 진행하면 정규 방정식 계산 과정에서 역행렬이 존재하지 않게 된다"는 것은 옳지 않습니다. 사실 정규화를 진행하면 역행렬의 존재 여부가 보장됩니다.

따라서, 정규화를 통해 (X^TX + \lambda I)가 역행렬을 가지게 되어 선형 회귀 문제를 안정적으로 풀 수 있습니다. 이로 인해 과적합을 방지하면서도 수치적으로 안정적인 해를 얻을 수 있습니다.

8

뉴런들이 여러 개의 층으로 구성되어 있죠

9

1 그렇게 볼 수 있죠

2 달라도 됩니다

3 입력층을 포함하지 말고 2개 이상이죠

4 맞습니다

10

1. 맞습니다

2. 그렇게 쭉쭉 퍼져나가는 거죠

3. ㄴㄴ 그럼 업데이트 안됩니다

4. 비용함수가 중앙에 있으면 그게 뭘로 계산되는건디...?

11

1. 균일한 분포를 가진 랜덤 값이 좋다고 그랬져

2. 줄 수도 있겠네요 할 값어치도 없으니....

3. ???? 그럼 학습이 안되는거 아닌가요..?

4. 수렴 안됩니다 or 엄처 오래 걸립니다.

12

학습 검증 테스트! (Train Validation Test)

13

학습곡선 2개를 그려보면 딱 나오져

14

1. 아녀유

2. 맞어여 데이터의 수가 엄청나게 불균형 된 문제들

3. 이건 아닐거 같아여

불균형 데이터 문제(Unbalanced Data Problem)는 클래스 간의 표본 수가 크게 차이나는 상황을 말합니다. 예를 들어, 이진 분류(binary classification)에서 긍정 클래스(positive class)가 1%이고 부정 클래스(negative class)가 99%인 경우가 있습니다. 이러한 상황에서는 분류기가 다수 클래스만 정확히 예측하더라도 높은 정확도를 보일 수 있어 학습이 어려워집니다.

불균형 데이터 문제의 정의

불균형 데이터 문제는 데이터의 클래스 비율이 불균형한 모든 경우에 적용됩니다. 이 문제는 클래스의 개수와 무관하게 발생할 수 있습니다. 클래스의 개수가 2개든, 10개든, 그 이상이든, 클래스 간의 표본 수가 크게 차이나면 불균형 데이터 문제에 직면하게 됩니다.

불균형 데이터 문제의 특징

- 클래스의 개수와 무관: 불균형 데이터 문제는 클래스의 개수와 상관없이 발생할 수 있습니다. 클래스의 개수가 2개일 수도 있고, 10개 이상일 수도 있습니다.

- 다수 클래스의 영향: 분류기가 다수 클래스에 편향될 수 있으며, 이는 소수 클래스의 분류 성능을 저하시킵니다.

- 평가지표의 왜곡: 정확도(accuracy)와 같은 단순한 평가지표는 불균형 데이터 문제를 제대로 반영하지 못할 수 있습니다.

결론

따라서 "불균형 데이터 분류 문제에 대해 묻는데 데이터 부류의 개수가 10개 이상인 문제라고 그러는데 이게 맞는거야?"라는 질문의 답변은:

- 불균형 데이터 문제는 클래스의 개수와 상관없이 발생할 수 있습니다.

- 클래스가 10개 이상인 경우에도 불균형 데이터 문제는 여전히 존재할 수 있습니다.

- 불균형 데이터 문제는 주로 클래스 간의 표본 수 차이에 의해 정의되므로, 클래스의 개수보다는 클래스 간의 표본 수 불균형이 중요한 요소입니다.

결론적으로, 불균형 데이터 문제는 클래스의 개수가 10개 이상일 때도 발생할 수 있으며, 클래스의 개수와 무관하게 표본 수의 불균형이 문제의 핵심입니다.

15

1 둘다 높아야 좋습니다

2. 평균 하지 말라고 그랬잖아요 ㅠ

3. f1이 맞습니다~

16

1. 경우 다 나뉘어 있습니다

2. 이 때 가우시안 커널 사용하라고 했던 것 같아서 맞는 것 같네요

3. 이 떄 SVM은 너무 오래 걸린다고 했습니다 ㅎㅎ

4. 계산량이 많다고 했습니다.

17

4번입니다. 클러스터 어딘지 찾고, 그에 따라 중앙으로 옮기기!

18

1. 빠질 수 있다 그랬습니다

2. 이건 너무 애매하잖아. 1% 확률이라도 똑같은 클러스터가 될 수 있지

3. 여러번 하다보면 피할 수도 있죠

4. 네 3번에서 가능했습니다. 여러번도

19

과적합 때 절 대 사용하지 말라고 했어유 강의에서

20

1. 네 그렇게 정했죠

2. 독립적이어야 그럴 수 있었죠

3. 보통은 6,2,2라고 그랬죠

4. 작아야 그럴 수 있습니다.

'인공지능 > 공부' 카테고리의 다른 글

| 모두를 위한 머신러닝 9 ~ 14주차 정리 (0) | 2024.06.10 |

|---|---|

| 모두를 위한 머신러닝 1 ~ 7주차 정리 (0) | 2024.06.09 |

| 생성형 인공지능 입문 - 14주차 퀴즈 (1) | 2024.06.03 |

| 생성형 인공지능 입문 - 14주차 transformer 기반 행동 생성 2 (0) | 2024.06.03 |

| 모두를 위한 머신러닝 - 14주차 퀴즈 (1) | 2024.06.03 |