AI는 편리함도 있지만 문제도 있다

윤리적 문제 - 딥페이크

편향적 데이터 학습 시 인종문제 등 윤리적 문제가 발생한다.

특이점이란 무엇인가?

약한 인공지능 - 자율주행 자동차, 알파고

강한 인공지능 - 인간 수준

음......

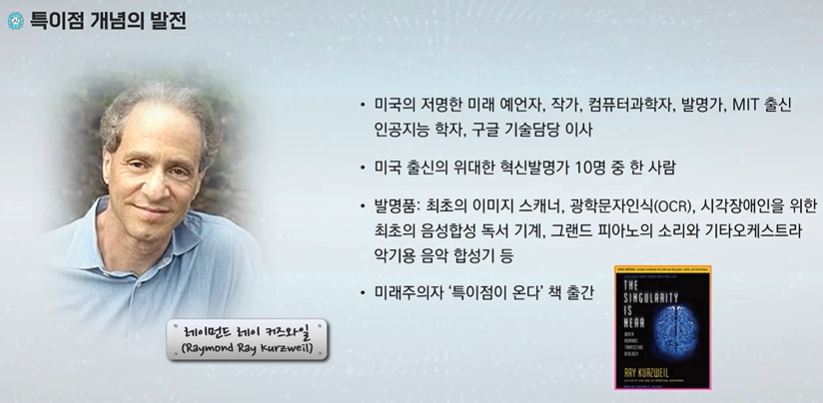

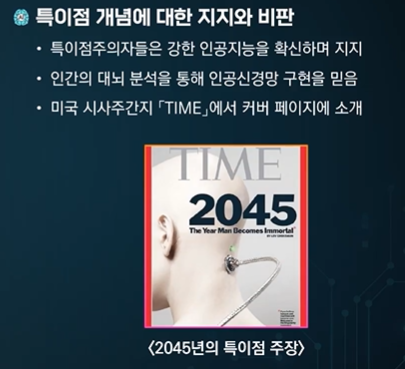

인공지능 특이점(Singularity)은 이론적인 개념으로, 인공지능 기술이 매우 발전하여 인간의 지적 능력을 초월하는 시점에 도달하는 것을 의미합니다. 이 개념은 미래학자와 과학자들 사이에서 논쟁의 여지가 많으며 다양한 견해가 존재합니다.

특이점이 올 것인지 여부에 대해서는 여러 가지 의견이 있습니다. 어떤 이들은 인공지능이 점점 더 능숙해지고 다양한 문제를 해결할 수 있게 되면서 결국 특이점에 도달할 수 있다고 생각합니다. 반면에, 다른 이들은 현재의 인공지능 발전이 제한되어 있고 특이점에 도달하기 위해서는 많은 근본적인 기술적 과제가 해결되어야 한다고 지적합니다.

결국 특이점이 실제로 일어날 것인지는 확실하지 않지만, 인공지능이 점점 더 다양한 분야에서 발전하고 있는 것은 분명합니다. 이 과정에서 사회, 경제, 윤리적인 문제를 고려하며 인공지능을 발전시키는 것이 중요합니다.

지금부터 인공지능 개발 방향을 잘 잡아야 한다.

증명가능한!

"증명 가능한 인공지능"은 인공지능의 결정이나 행동을 인간이 이해하고 검증할 수 있도록 설계된 인공지능 시스템을 의미합니다. 이러한 시스템은 그들의 결정 과정이 투명하고, 이해 가능하며, 신뢰성이 있어야 합니다. 즉, 인공지능 시스템이 어떤 결정을 내렸는지, 왜 그런 결정을 내렸는지를 인간이 확인하고 이해할 수 있어야 한다는 것입니다.

증명 가능한 인공지능의 중요성

증명 가능한 인공지능은 특히 중요한 의사 결정을 내리는 분야에서 중요합니다. 예를 들어, 의료, 금융, 법적 판단 등의 분야에서 인공지능이 인간의 생명이나 권리에 직접적인 영향을 미칠 수 있는 결정을 내릴 때, 그 결정 과정이 명확하게 드러나야 합니다. 이는 잘못된 결정으로 인한 위험을 최소화하고, 오류가 발생했을 때 그 원인을 파악하여 시정 조치를 취할 수 있게 해줍니다.

증명 가능한 인공지능의 구현

증명 가능한 인공지능을 구현하기 위해서는 몇 가지 기술적 접근 방법이 필요합니다:

- 모델의 투명성: 인공지능 모델이 어떻게 데이터를 처리하고 결정을 내리는지 이해할 수 있어야 합니다. 이를 위해 복잡한 딥러닝 모델보다는 의사결정 트리나 규칙 기반 시스템과 같이 비교적 이해하기 쉬운 모델이 사용될 수 있습니다.

- 결정 과정의 문서화: 인공지능 시스템의 결정 과정에 대한 문서화를 통해, 시스템이 어떤 정보를 기반으로 결정을 내렸는지 명확히 할 수 있습니다.

- 감사 및 모니터링: 인공지능 시스템의 결정을 정기적으로 감사하고 모니터링함으로써, 시스템의 성능을 검증하고 필요한 경우 조정할 수 있습니다.

증명 가능한 인공지능은 앞으로 기술의 신뢰성과 책임성을 확보하기 위한 중요한 연구 분야입니다. 이 분야의 발전은 인공지능 기술이 더욱 널리 수용되고 사회적으로 신뢰받는 데 기여할 수 있습니다.

인간에 의해 통제받지 않고, 성능을 우선시하여 만든다면 AI가 자신만의 이익을 위할 수 있다.

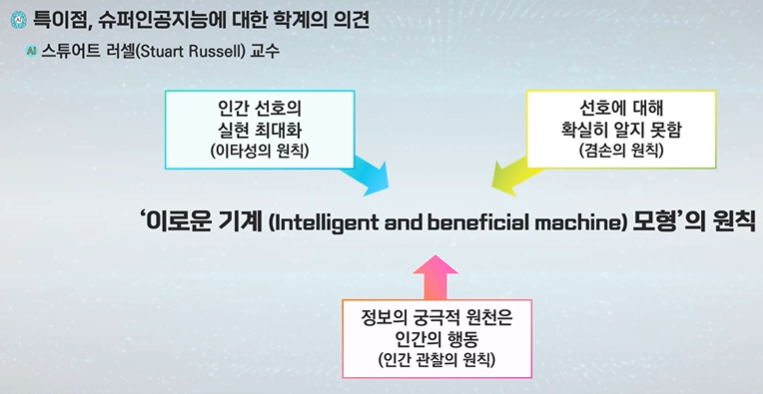

사람에게 이로워야 한다!

인공지능은 어떠한 경우에도 사람을 자신보다 위에 둬야 하며, 제대로 이해가 되지 않으면 물어봐야 한다!

이렇게 하면 슈퍼 인공지능이 나와도 인간이 통제 할 수 있다고 한다.

최초의 인공지능 개발부터 이 3단계를 잘 지키면서 개발하면 슈퍼 인공지능이 등장해도 통제할 수 있을 것이다.

'인공지능 > 공부' 카테고리의 다른 글

| 인공지능과 빅데이터 10주차 3차시 - 인공지능 윤리의 중요성과 원칙 (0) | 2024.05.07 |

|---|---|

| 인공지능과 빅데이터 10주차 2차시 - 인공지능 윤리이슈 (1) | 2024.05.07 |

| 생성형 인공지능 입문 9주차 퀴즈 (0) | 2024.05.02 |

| 생성형 인공지능 입문 9주차 5차시 - 가짜 식별 네트워크 2 (fake detection network) (0) | 2024.05.02 |

| 생성형 인공지능 입문 9주차 4차시 - 가짜 식별 네트워크 1 (fake detection network) (0) | 2024.05.02 |