728x90

728x90

이전에는 엔진 파어만을 통해 자동차 가격을 예측했다.

비용함수를 최소화하는 값을 찾으면 그 값을 가설에 대입하면 끝이었다.

데이터는 205개가 주어졌다.

cost function은 비슷하다. 그저 하나가 늘은 것 뿐이다.

변수가 여러가지라면 벡터로 표현하면 편하다.

w*는 최적 값이다.

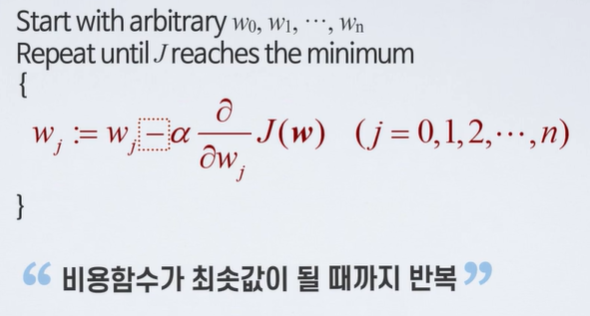

경사 하강법

변수가 한개일 경우

변수가 2개 이상일 경우

특징의 개수 - n

학습 데이터 개수 - m

데이터의 총 개수는 205개이다.

w0는 바이어스 파라미터이다. -> x에 1을 하나 추가해준다.

이 것도 벡터화 시킬 수 있다.

우리 x0 = 1로 만들어서 굳이 안나눠도 되지 않나...?

728x90

'인공지능 > 공부' 카테고리의 다른 글

| 머신러닝 3주차 3차시 - 경사 하강, 학습 속도 (0) | 2024.03.18 |

|---|---|

| 머신러닝 3주차 2차시 - 특징 값 스케일링 (0) | 2024.03.18 |

| 인공지능과 빅 데이터 3주차 3차시 - 규칙기반 시스템, 전문가 시스템 (1) | 2024.03.18 |

| 인공지능과 빅 데이터 3주차 2차시 - 지식 표현과 추론, 지식 표현의 불확실성 (2) | 2024.03.18 |

| 인공지능과 빅 데이터 3주차 1 - 규칙 기반 시스템, 지식 기반 시스템 (0) | 2024.03.18 |