https://arxiv.org/abs/1607.06520

Man is to Computer Programmer as Woman is to Homemaker? Debiasing Word Embeddings

The blind application of machine learning runs the risk of amplifying biases present in data. Such a danger is facing us with word embedding, a popular framework to represent text data as vectors which has been used in many machine learning and natural lan

arxiv.org

워드 임베딩은 데이터 내 성별 고정관념을 반영해 man:computer programmer, woman:homemaker와 같은 편향된 결과를 초래할 수 있다.

성별 서브스페이스를 PCA로 정의하고, 중립 단어에서 성별 성분을 제거하는 방법을 제안

Hard Debiasing은 편향을 강력하게 제거하지만 의미적 세부 차이가 손실될 수 있다.

Soft Debiasing은 편향을 완화하며 임베딩 구조를 최대한 유지한다.

이 방법은 성별 편향을 줄이는 데 성공했지만, 간접 편향의 잔존과 특정 응용에서의 의미 왜곡 가능성이 한계로 남는다.

논문 요약: Man is to Computer Programmer as Woman is to Homemaker? Debiasing Word Embeddings

1. 문제가 무엇인지?

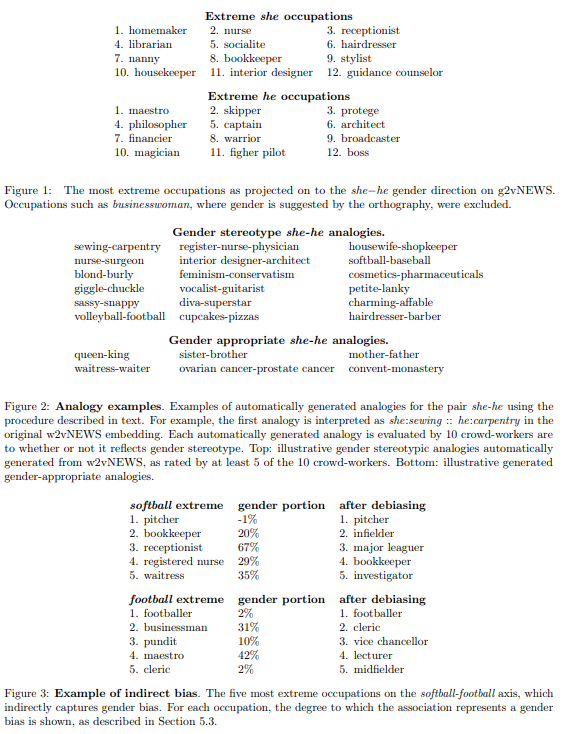

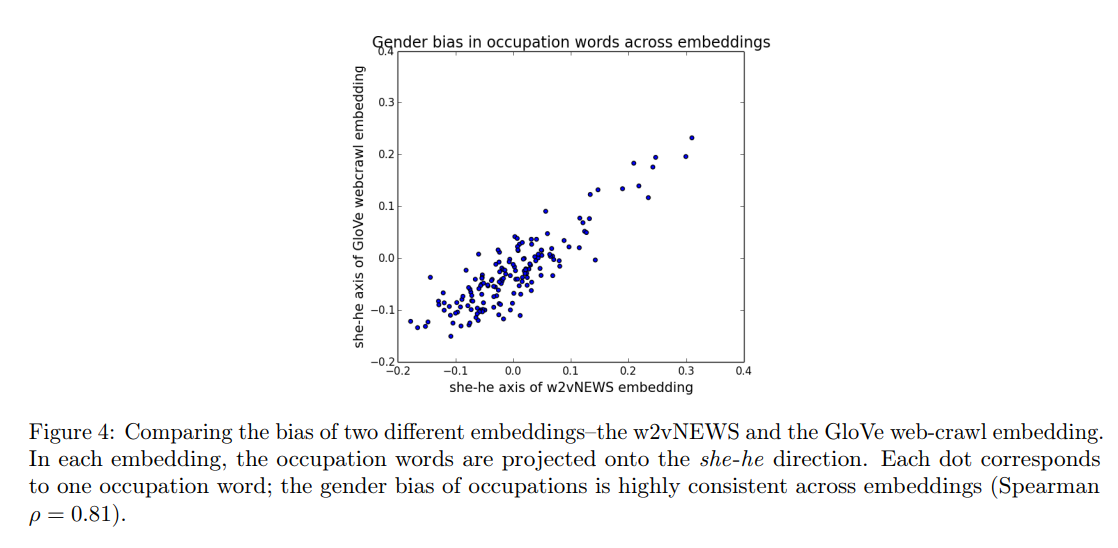

이 논문은 워드 임베딩(word embeddings)에서 발견되는 성별 고정관념(gender stereotypes)을 문제로 다룹니다. 워드 임베딩은 자연어 처리에서 필수적인 도구로 사용되지만, 훈련 데이터의 편향을 반영하여 성차별적인 결과를 낼 수 있습니다. 예를 들어, man:computer programmer::woman:homemaker와 같은 성별 고정관념을 드러냅니다. 이러한 문제는 검색엔진, 추천 시스템 등 실제 응용에서 성차별을 증폭시키는 결과를 낳을 수 있습니다.

2. 어떤 방법을 사용했는지?

- 성별 서브스페이스(Gender Subspace) 정의:

- 임베딩 내에서 성별 편향을 설명하는 저차원 서브스페이스를 정의.

- 성별 정의 단어(예: he-she, man-woman)를 사용하여 이 서브스페이스를 계산.

- 성 중립화 및 편향 완화 알고리즘:

- Hard Debiasing: 성별 중립 단어에서 성별 서브스페이스 성분을 제거하고, 성별 정의 단어의 의미를 유지.

- Soft Debiasing: 임베딩의 원래 구조를 유지하면서 편향을 완화하는 방법.

- 편향 측정 및 평가:

- 직간접 편향(direct & indirect bias) 측정을 위한 새로운 지표 정의.

- 작업 성능(유사성 계산, 아날로지 해결) 평가를 통해 임베딩 유용성 보장.

3. 결과는 어떻게 되는지?

- 편향 완화 성과:

- Hard Debiasing은 성별 고정관념 아날로지의 19%에서 6%로 감소.

- Soft Debiasing은 더 낮은 수준의 편향 감소를 보였으나 원본 데이터 구조를 더 잘 유지.

- 임베딩 유용성 유지:

- 표준 평가 지표(유사성, 아날로지 테스트)에서 성능 저하 없음.

- 간접 편향 완화:

- "softball-football" 같은 간접 편향 축에서 관련 없는 성별 연관성을 줄이는 데 성공.

4. 한계점은 무엇인지?

- 간접 편향의 정의와 측정:

- 간접 편향을 정확히 측정하는 데 어려움. 직관적 사례 연구에 의존함.

- 언어 및 문화적 편향:

- 영어 중심 연구로, 다른 언어(특히 문법적 성별이 존재하는 언어)에 적용 가능성 미검증.

- 편향 완화의 완전성:

- Hard Debiasing은 의미 구조를 단순화할 위험이 있으며, Soft Debiasing은 편향 완화 수준이 낮음.

- 확장성 문제:

- 대규모 임베딩(수백만 개 단어)을 처리하는 데 계산 복잡도 문제가 있음.

5. 논문의 타당성과 아쉬운 점

- 타당성:

- 워드 임베딩에서의 편향 문제를 체계적으로 분석하고, 편향 완화를 위한 알고리즘을 설계.

- 편향 제거와 임베딩 유용성 간의 균형을 고려한 설계가 돋보임.

- 아쉬운 점:

- 다양한 형태의 편향(인종, 계층 등)을 다루는 연구가 제한적.

- 편향 완화 알고리즘의 정량적 효과를 다른 언어와 데이터셋에서 검증하지 못함.

6. 이 논문이 인공지능 해석 및 편향 연구에 주는 함의

- 기술적 기여:

- 성별 서브스페이스 정의 및 제거 방식은 편향 연구에서 모델 내부 해석성을 높이는 데 활용 가능.

- 간접 편향 측정 지표는 다른 편향(인종, 문화적 편향) 연구에도 응용 가능.

- 응용 가능성:

- 편향 제거 후 모델의 성능 평가 방법은 인공지능 모델의 사회적 책임성을 높이는 데 사용될 수 있음.

- 미래 연구 방향:

- 다른 유형의 편향(예: 인종적, 경제적)에 대한 편향 제거 확장.

- 다국어 임베딩 및 대규모 LLMs에 대한 적용 연구 필요.

이 논문은 LLM의 편향 분석과 수정에서 유용한 출발점을 제공합니다. Sparse Autoencoder와 결합하여 편향된 특징을 제거하는 방식과 비교하며 실험을 설계할 수도 있을 것입니다.

여기서 서브스페이스를 어떻게 정의했는지, 그 성분을 어떻게 제거했는지, 임베딩 원래 구조를 유지하면서 편향을 완화시켰는지 논문을 기반으로 설명해주라

서브스페이스 정의 및 제거 방법, 그리고 편향 완화의 과정

1. 서브스페이스 정의 방식

서브스페이스는 워드 임베딩 내에서 성별 편향을 나타내는 축(성별 방향)을 정의하기 위해 다음 단계를 거쳤습니다:

- 성별 정의 단어 선정:

- 성별을 명시적으로 나타내는 단어 쌍(예: he-she, man-woman, father-mother, boy-girl)을 사용.

- 각 단어 쌍의 임베딩 벡터 차이(예: he - she)를 계산.

- 주성분 분석(PCA) 사용:

- 여러 단어 쌍의 벡터 차이를 PCA를 통해 분석하여, 이들 벡터가 공유하는 주요 방향을 추출.

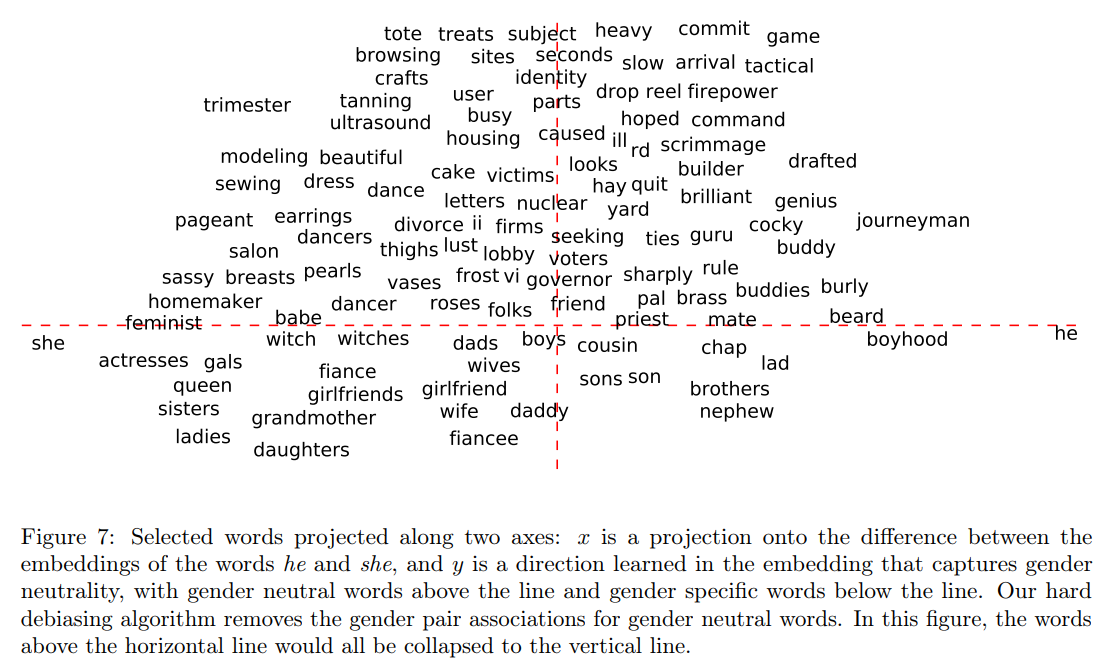

- 이 첫 번째 주성분이 성별 서브스페이스를 나타내는 방향(gender subspace)으로 정의됨.

- 성별 서브스페이스가 고차원적일 가능성을 열어두었으나, 이 연구에서는 주로 1차원 방향으로 분석.

2. 서브스페이스 성분 제거 방식

서브스페이스에서 성별 관련 성분을 제거하는 과정은 아래와 같습니다:

- 단어 벡터 분해:

- 단어 벡터 w를 두 성분으로 분해:

- 서브스페이스 성분: w_g=(w⋅g)g

(여기서 는 성별 서브스페이스 방향 벡터) - 직교 성분: w⊥=w−wg

- 서브스페이스 성분: w_g=(w⋅g)g

- 단어 벡터 w를 두 성분으로 분해:

- 성별 성분 제거:

- 중립 단어(gender-neutral word)의 경우, 벡터를 서브스페이스에 직교하는 성분으로만 재구성:

w′=w⊥=w−w_g

- 중립 단어(gender-neutral word)의 경우, 벡터를 서브스페이스에 직교하는 성분으로만 재구성:

- 단위 벡터로 정규화:

- 제거 후 벡터를 정규화하여 임베딩 공간의 단위 벡터 성질을 유지.

3. 편향 완화와 임베딩 구조 유지

편향을 완화하면서도 워드 임베딩의 원래 구조(단어 간 의미적 관계)를 유지하기 위해 두 가지 방법을 제안했습니다:

(1) Hard Debiasing (엄격한 편향 제거):- 성별 중립 단어를 성별 서브스페이스의 영향에서 완전히 제거.

- 성별 정의 단어(예: mother-father)는 원래의 성별 관계를 유지하도록 설계.

- 장점: 편향 제거가 강력하며, 명시적 편향 문제를 해결.

- 단점: 일부 의미적 세부 관계가 손실될 수 있음.

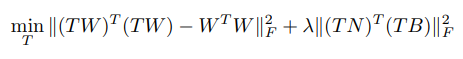

- 임베딩 전체에 선형 변환 TT를 적용하여 성별 서브스페이스를 최소화하는 동시에, 단어 간 내적(inner product)을 최대한 유지.

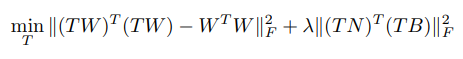

- 최적화 문제 정의:

- 첫 번째 항: 변환 후에도 단어 간 유사성을 유지.

- 두 번째 항: 성별 중립 단어의 서브스페이스 성분 최소화.

- λ: 편향 제거와 구조 유지 간의 균형을 조절하는 하이퍼파라미터.

4. 성능 유지 방법

- 평가 기준:

- 유사성 평가(RG, WS)와 아날로지 문제(MSR analogy)를 활용.

- Debiasing 이후에도 성능 감소가 없음을 입증.

- 직간접 편향 감소:

- Softball과 Football 축과 같은 간접 편향을 줄이며 관련없는 성별 연관성을 완화.

결론

이 논문은 성별 서브스페이스를 정의하고 제거하여 편향을 완화하는 데 성공했습니다. Hard Debiasing은 강력한 제거를, Soft Debiasing은 유용한 관계를 최대한 유지하며 완화를 수행합니다. Sparse Autoencoder와 결합하여 유사한 방식으로 편향된 특징을 제어하는 연구에 적용 가능성이 높습니다.

예시를 기반으로 한 번 더 자세하게 설명해주라

서브스페이스 정의, 제거 및 편향 완화: 예시를 기반으로 상세 설명

1. 서브스페이스 정의: 성별 방향(gender subspace) 찾기

목표: 워드 임베딩에서 성별 고정관념을 나타내는 축을 찾기 위해, 성별을 대표하는 단어 쌍들의 벡터 차이를 사용합니다.

- 단어 쌍 정의:

- 성별을 명시적으로 표현하는 단어 쌍을 선정: 예를 들어 he-she, man-woman, father-mother, boy-girl.

- 각 단어 쌍에 대해, 벡터 차이를 계산:

성별 벡터 차이=벡터(he)−벡터(she),…

- 벡터 차이 모음과 주성분 분석(PCA):

- 모든 단어 쌍의 벡터 차이를 모아 매트릭스를 형성.

- PCA를 통해 이 벡터 차이들의 주성분(Principal Component)을 추출.

- 첫 번째 주성분이 대부분의 성별 차이를 설명하는 성별 서브스페이스(gender subspace) 방향 g로 설정.

- 예시:

- he-she의 벡터 차이와 man-woman의 벡터 차이가 비슷한 방향을 가리킨다고 가정.

- PCA 결과에서 g 방향이 [0.5,0.3,−0.7,… ]와 같은 단일 벡터로 표현될 수 있습니다.

2. 서브스페이스 성분 제거: 중립 단어에서 성별 성분 제거

목표: 성별과 관계없는 중립 단어(예: nurse, teacher)에서 성별 서브스페이스의 영향을 제거.

- 단어 벡터 분해:

- 임베딩 벡터 w를 성분 분해:

- 서브스페이스 성분(성별 관련): w_g=(w⋅g)g

- 직교 성분(성별과 무관): w⊥=w−w_g

- nurse 벡터: [0.8,0.2,0.6,0.4]

- 서브스페이스 방향 : [0.5,0.3,−0.7,… ]

- 계산: w_g=([0.8,0.2,0.6,0.4]⋅[0.5,0.3,−0.7,… ])[0.5,0.3,−0.7,… ]

- w⊥=[0.8,0.2,0.6,0.4]−w_g

- 임베딩 벡터 w를 성분 분해:

- 성별 성분 제거:

- 중립 단어의 새로운 벡터 w′w를 w⊥로 설정.

- w′는 성별 성분이 제거된 벡터.

- 결과:

- 원래 nurse 벡터가 [0.8,0.2,0.6,0.4]였다면, 성별 서브스페이스 제거 후에는 [0.7,0.1,0.5,0.3]와 같은 벡터로 변경.

3. 원래 구조 유지하며 편향 완화: Soft Debiasing

목표: 원래 임베딩 구조를 최대한 유지하면서 편향을 완화.

- 최적화 문제 정의:

- T를 임베딩 전체에 적용할 선형 변환 행렬로 설정.

- 최적화 목표:

- 임베딩 구조 유지: 단어 간 내적(inner product)을 최대한 보존.

- 편향 최소화: 중립 단어에서 성별 서브스페이스 성분 제거.

- 수식:

- W: 모든 단어 벡터.

- : 중립 단어 벡터.

- B: 성별 서브스페이스 벡터.

- λ: 구조 유지와 편향 완화 간의 균형 조절.

- 결과:

- 원래 nurse 벡터와 doctor 벡터가 성별 관련 편향이 강하게 나타난다면, 변환 후 이 두 단어는 성별과 무관한 관계를 유지.

4. 결과 평가

- 직접 편향 제거:

- nurse와 doctor가 성별에 따라 다르게 연관되던 것을 제거.

- 아날로지 문제에서 he:doctor::she:X가 이제 X=nurse 대신 X=physician과 같이 중립적인 결과를 반환.

- 간접 편향 완화:

- softball-football 축에서 receptionist나 homemaker가 더 이상 여성적 단어로 강하게 연관되지 않음.

요약

성별 서브스페이스는 단어 쌍 벡터 차이를 기반으로 PCA로 정의되었습니다. 중립 단어에서 성별 서브스페이스 성분을 제거하거나 완화하여 편향을 줄였으며, 동시에 단어 간 의미적 관계를 유지하려 노력했습니다. 이 방식은 모델 내 편향을 분석하고 줄이는 데 있어 중요한 기술적 기반을 제공합니다.

그럼 이런 방법을 통해서 성별 편향을 줄이긴 한 것이네?

그런데 출력에 문제가 생길 것 같기는 한데 아니야...?

맞아요! 이런 방식으로 성별 편향을 줄이는 데 성공했지만, 말씀하신 것처럼 출력에 문제가 생길 가능성도 있습니다. 특히, 워드 임베딩의 구조를 수정하거나 성분을 제거할 때 예상치 못한 부작용이 발생할 수 있습니다. 논문에서도 언급된 몇 가지 잠재적인 문제와 그 이유를 자세히 살펴보겠습니다.

1. 출력에서 문제가 생길 가능성

(1) 단어 간 미묘한 의미적 차이 손실

- 문제:

- hard-debiasing에서는 성별 서브스페이스를 완전히 제거하기 때문에 중립 단어 간의 성별 관련 의미적 차이가 손실될 수 있습니다.

- 예를 들어, grandfather와 grandmother는 의미적으로 비슷하면서도 다른 뉘앙스를 가질 수 있지만, 완전한 성별 중립화 과정에서는 이 차이가 사라질 위험이 있습니다.

- 결과적으로, "to grandfather a regulation"과 같은 표현이 "to grandmother a regulation"처럼 처리될 수 있습니다.

- 영향:

- 잘못된 맥락에서 단어를 사용하거나, 자연스러운 언어 표현이 왜곡될 가능성이 생깁니다.

(2) 유용한 성별 정보 상실

- 문제:

- 어떤 응용에서는 성별 정보를 이용해 정확한 출력이 필요한 경우가 있습니다.

- 예: 자연어 생성 모델에서 she와 he의 명확한 구분은 문맥적으로 필수적일 수 있습니다.

- 성별 서브스페이스를 제거하면, "she is a mother"와 "he is a father"처럼 성별에 따라 자연스러운 문장을 생성하는 능력이 저하될 수 있습니다.

- 영향:

- 성별 정의 단어(mother, father)와 같은 경우를 잘못 처리하거나 부자연스러운 출력을 생성할 위험이 있습니다.

(3) 간접적 편향의 잔존

- 문제:

- soft-debiasing은 편향을 완전히 제거하지 않고 완화하는 방식이기 때문에, 간접적 편향(indirect bias)이 여전히 남아 있을 가능성이 있습니다.

- 예: "softball-football" 축에서 nurse나 receptionist가 성별 연관성을 완전히 제거하지 못하고, 여전히 약간의 편향을 유지할 수 있습니다.

- 영향:

- 편향 완화가 부족하여 일부 응용에서 여전히 차별적인 결과를 낼 가능성이 있습니다.

2. 논문에서 언급된 대처 방법

논문은 출력 문제를 최소화하기 위해 다음과 같은 대처 방법을 제안합니다:

(1) 성별 정의 단어 보존

- 방법: 성별을 명확히 정의하는 단어(father-mother, he-she)는 제거하지 않고 유지.

- 효과: 성별이 반드시 필요한 맥락에서 올바른 관계를 유지.

(2) Soft Debiasing으로 유연성 확보

- 방법: 완전 제거(hard-debiasing)가 아닌, 성별 서브스페이스의 성분을 줄이는 soft-debiasing 적용.

- 효과: 단어 간의 유사성을 최대한 보존하며, 중립적 단어에서 편향을 완화.

(3) 맥락 의존적 편향 완화

- 방법: 응용에 따라 편향 제거의 강도를 조정.

- 예: 기계 번역 시스템에서는 편향 완화를 최소화하여 문맥적 성별 정보를 유지.

- 효과: 특정 작업에서 자연스러운 출력을 보장.

3. 실제로 발생 가능한 출력 문제에 대한 대안

- Task-specific Debiasing:

- 작업에 따라 편향 제거 강도를 조정하는 방식.

- 예: 편향 제거가 필요 없는 문맥에서는 원본 임베딩을 사용하는 하이브리드 접근법.

- 멀티-서브스페이스 모델링:

- 성별뿐만 아니라 다른 요인(인종, 계층 등)의 서브스페이스를 고려하여 더 정교한 편향 제거.

- 정량적 평가:

- 성능 평가를 성별 편향 제거 전후로 비교하며, 편향 감소와 출력 자연스러움 간의 균형을 모니터링.

4. 결론

성별 서브스페이스 제거는 성별 편향을 줄이는 효과적인 방법이지만, 출력에서 의미적 관계 손실이나 문맥 왜곡 문제가 발생할 수 있습니다. 이를 해결하기 위해:

- 응용 상황에 맞는 유연한 편향 제거 전략을 적용.

- Soft Debiasing처럼 원래 임베딩 구조를 최대한 보존하는 방법 활용.

- 특정 작업에서는 편향 완화의 정도를 조절하여 자연스러움을 유지해야 합니다.

이 논문을 기반으로 Sparse Autoencoder를 활용하여 편향을 학습하고 제거하는 실험도 유사한 방식으로 설계할 수 있을 것입니다.