728x90

728x90

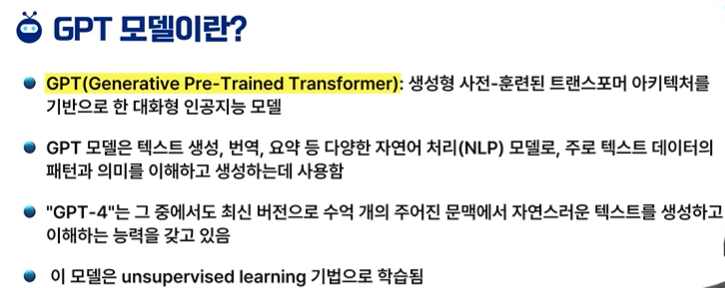

GPT 와 ELMo!

텍스트 생성, 번역, 요약 등 다양한 역할이 가능하다.

Unsupervised learning -> 코퍼스를 정제는 하되 라벨링을 하진 않는다.

fine turning -> 물어본 것에 대한 정해진 답을 정해준다.

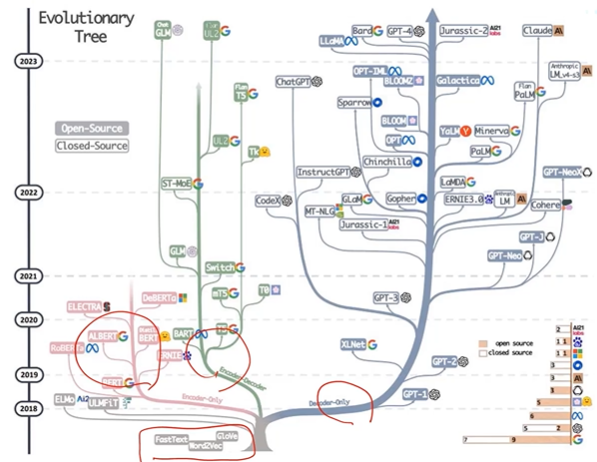

BERT - incorder에 집중

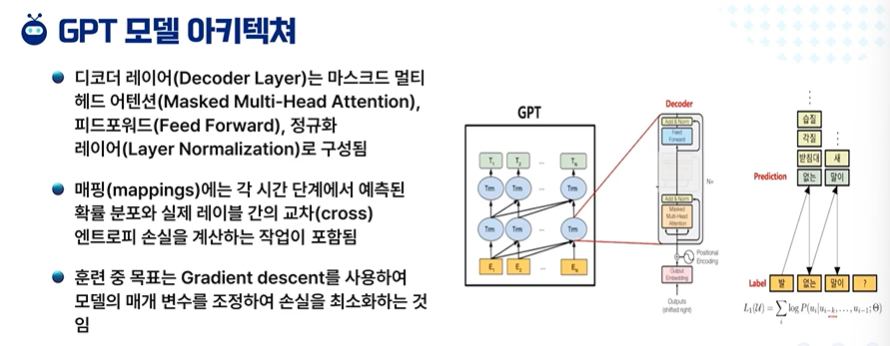

Decorder 만 있다. - 학습시킬 땐 인코더가 있다. -> 학습 완료 후 디코더만 사용한다.

기본적 구조는 Transformer, 대용량 feedforward이다.

GPT 모델 구조는 어떻게 되어있나?

비지니스 모델에서는 출력 표현에 노하우가 많이 들어간다.

자연스러운 텍스트 생성 - fine turning을 잘 한다.

interactive - 대화형 응답 능력 : 각자에게 특화되어 대화를 한다.

transfer learning을 통해 다른 도메인에서 바로 사용할 수 있는 네트워크를 만들 수 있다.

코퍼스에 기반해있다. - 일관성이 부족하다. (감정, 자아가 있는 것이 아니다.)

728x90

'인공지능 > 공부' 카테고리의 다른 글

| 생성형 인공지능 입문 6주차 4차시 - interactive GPT model (대화형 GPT 모델) (0) | 2024.04.10 |

|---|---|

| 생성형 인공지능 입문 6주차 3차시 - Fine tuning(미세조정) (0) | 2024.04.10 |

| 모두를 위한 머신러닝 6주차 퀴즈 (0) | 2024.04.10 |

| 생성형 인공지능 입문 6주차 1차시 - BERT model (0) | 2024.04.08 |

| 머신러닝 6주차 5차시 - 논리 함수 구현 (0) | 2024.04.08 |